Qu'est-ce que l'index Google ?

L'index Google est une base de données regroupant tous les sites internet que le moteur de recherche a explorés et stockés afin de les utiliser dans les pages de résultats.

Il fonctionne comme une immense bibliothèque consultable de contenus numériques. Il stocke le texte de chaque page web, ainsi que des métadonnées importantes telles que les titres, les en-têtes, les liens, les images, etc. 📚

Toutes ces données sont compilées dans un index structuré que Google peut scanner instantanément pour faire correspondre les requêtes de recherche avec des résultats pertinents. 👀

Qu'est-ce que le crawling ?

Le crawling est le processus par lequel les moteurs de recherche découvrent les pages nouvelles et les mises à jour sur le web.

Cette tâche est effectuée par des programmes automatisés appelés «crawlers». Le crawler le plus connu est «Googlebot». En substance, il s’agit du navigateur web Chrome que beaucoup d'entre nous utilisons, mais sans contrôle humain.

Google parcourt des milliards de contenus et évalue toute une série de facteurs afin de déterminer quels sont ceux qui sont les plus susceptibles de répondre aux requêtes des internautes.

Googlebot (aussi appelé robot, bot ou spider) utilise un protocole, basé sur un algorithme en constante évolution, pour déterminer les sites à crawler, la fréquence et le nombre de pages à récupérer sur chaque site web. Les fonctionnalités spécifiques de l'algorithme n'ont jamais été explicitement divulguées par Google, mais les experts SEO n'ont de cesse d'essayer de définir les tendances comportementales de Googlebot. 🕵️

Crawlers primaires et secondaires

Google a également mis en place deux types de crawlers : un crawler mobile et un crawler de bureau. 📱💻

Ils simulent en permanence la visite d'un utilisateur sur des pages web. Il est donc impératif de vous assurer que votre site est optimisé pour les deux types de plateformes.

Les internautes naviguent désormais majoritairement sur leur smartphone. Compte tenu de tout cela, Google a mis en place en 2019 une pratique d'indexation «mobile first», ce qui signifie qu'il utilise principalement la version mobile de votre contenu pour indexer et classer vos pages web.

C'est pourquoi certains web designers choisissent désormais de créer des sites web d’abord adaptés aux mobiles et ensuite aux ordinateurs de bureau (alors que traditionnellement, on fait l'inverse). Cela dit, aucune approche n'est mauvaise. Tant que votre site web est optimisé pour les appareils mobiles, il sera rapidement exploré par Googlebot.

Comment fonctionne le crawling ?

1. Point de départ : les crawlers commencent leur parcours à partir d'une liste d'URLs connues. Il peut s'agir de sites web déjà indexés ou d'URLs fournies par des webmasters via des outils tels que Google Search Console.

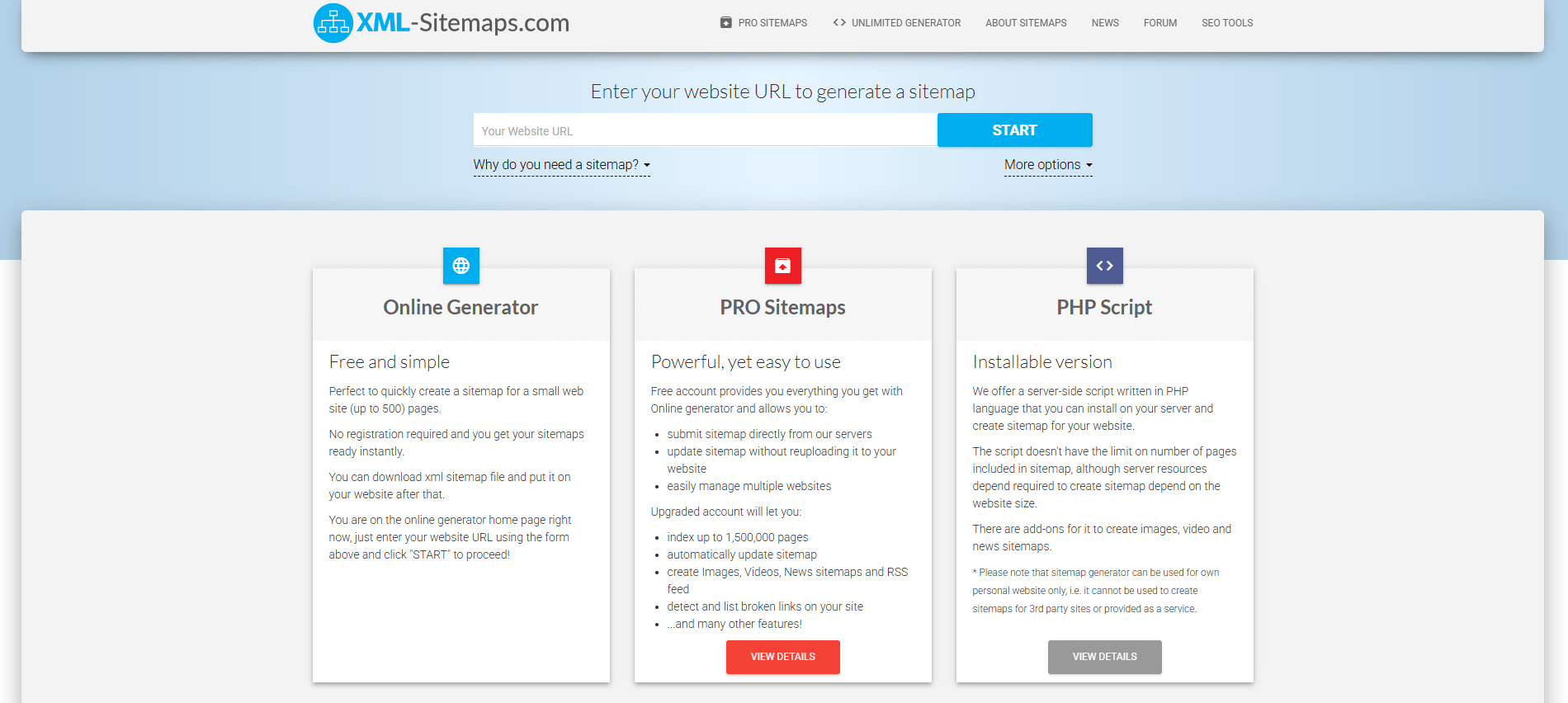

C'est l'une des raisons pour lesquelles un

plan de site XML est utile, car il sert justement à lister les URLs. 📜

2. Suivi des liens : lorsque les robots d'exploration parcourent le web, ils suivent les liens sur chaque page qu'ils visitent, découvrant ainsi de nouvelles pages. 🔗

En réalité, les liens sont ajoutés à la liste d'exploration, mais les robots ne les explorent pas nécessairement immédiatement. ⏳

3. Récupération du contenu : une fois qu'un robot d'exploration arrive sur une page, il récupère le contenu pour l'analyser (code HTML, structure, texte, images, métadonnées…).

4. Stockage des informations : les informations de la page sont ensuite stockées et utilisées dans le processus d'indexation.

Qu'est-ce que l'indexation ?

L'indexation est l'étape qui suit le crawling.

Elle consiste à analyser et à stocker le contenu récupéré par les crawlers dans la base de données du moteur de recherche.

Éléments clés de l'indexation

- Analyse du contenu : le moteur de recherche essaie de comprendre le sujet de la page. Cela comprend l'analyse du texte, des images, des métadonnées et même de la structure de celle-ci. Les moteurs de recherche décident alors si la page est utile, unique ou suffisamment importante pour être stockée.

- Stockage dans l'index : le contenu est ensuite organisé et stocké dans l’index.

- Signaux de classement : lors de l'indexation, les moteurs de recherche évaluent également la pertinence du contenu par rapport à diverses requêtes de recherche. Des facteurs tels que les balises de titre, les en-têtes, le corps du texte de la page, la vitesse de chargement, la compatibilité avec les appareils mobiles et les liens entrants jouent un rôle de première importance.

Problèmes techniques pouvant affecter l'exploration et l'indexation

Certains problèmes techniques peuvent donner l'impression qu'un site est de mauvaise qualité, ce qui peut nuire à sa visibilité dans les résultats de recherche.

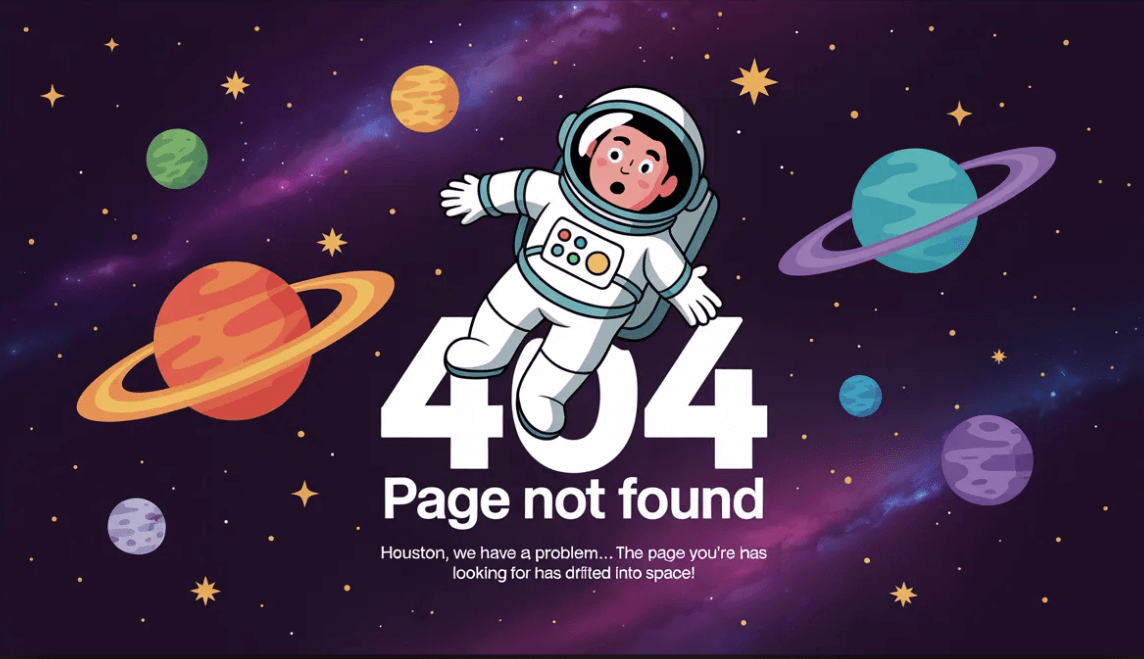

1. Liens rompus : les liens qui mènent à des pages inexistantes (erreurs 404) peuvent frustrer à la fois les utilisateurs et les robots d'exploration, car ils indiquent une mauvaise maintenance du site.

2. Contenu dupliqué : le fait d'avoir le même contenu sur plusieurs pages (sur le même site ou sur différents sites web) peut semer la confusion dans l'esprit des moteurs de recherche quant à la page à classer, ce qui peut entraîner une baisse du classement. 📉

3. Temps de chargement des pages trop longs : les moteurs de recherche préfèrent les sites qui se chargent rapidement. Les pages les plus lentes peuvent même n'être que partiellement explorées ou même ignorées. 🐌

4. Design non responsive : la majorité des recherches s'effectuant désormais sur des smartphones ou tablettes, un site qui n'est pas adapté peut être pénalisé dans les résultats mobiles.

5. Mauvaise configuration du fichier robots.txt : un fichier « robots.txt » mal configuré peut accidentellement empêcher l'exploration de pages importantes, ce qui entraîne des lacunes dans l'indexation.

6. Mauvaise configuration des balises Meta Robots et Canonical : ces balises peuvent être utilisées pour empêcher les moteurs de recherche d'indexer des pages et constituent un outil utile.

Attention

Mal utilisées, elles peuvent entraîner l'ignorance de pages importantes par les moteurs de recherche. ⚠️

Indexation vs exploration

L'exploration et l'indexation sont deux processus distincts, qui sont souvent mal compris dans le secteur du référencement. L'exploration signifie que Googlebot interprète le contenu et le code de la page, tandis que l'indexation signifie que la page devient éligible pour apparaître dans les résultats de recherche Google.

Les doublons identifiés comme étant des URLs alternatives d'une même page, par exemple pour les versions mobile ou bureau d'un même contenu, ou pour différents publics régionaux comme le français canadien ou belge, ne feront pas l'objet d'une pénalité, à condition que vous classiez la page web avec les attributs HTML appropriés pour expliquer son existence.

Classement et visibilité

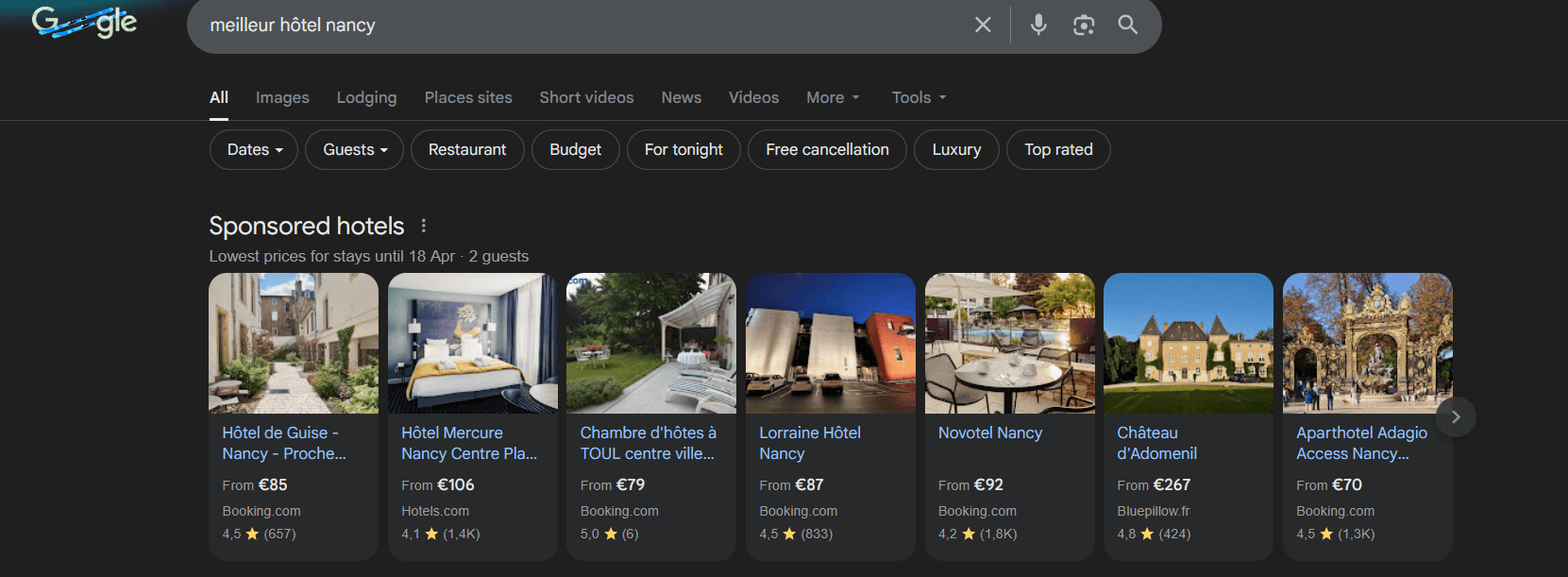

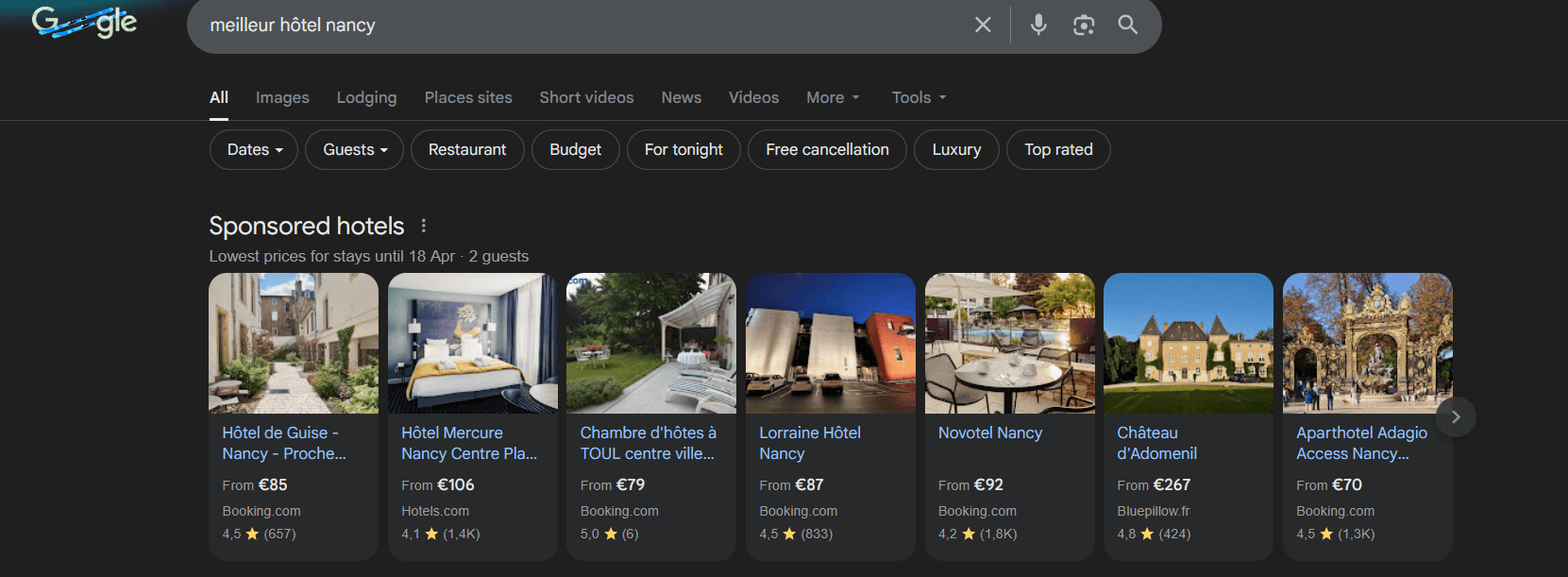

Le classement fait référence au processus utilisé pour déterminer où un contenu particulier doit apparaître sur la page de résultats de Google ( = SERP). La visibilité organique fait référence à la place occupée par les sites web dans les résultats.

Les fonctionnalités SERP les plus courantes sont les suivantes :

-

Résultats payants : résultats achetés en enchérissant sur des mots-clés. (par exemple, Google Ads)

-

Résultats universels : différents types de contenu (images, actualités, extraits optimisés…)

-

Graphique de connaissances : données séparées sous différentes formes ( lieux, entreprises ou associations, sites web…)

Lorsqu'un utilisateur saisit une requête de recherche, Google parcourt son index, tout en tenant compte de métadonnées telles que la localisation, la langue et le type d'appareil de l'internaute.

Google prend également en compte l'expérience-utilisateur, accordant une importance considérable à la vitesse de chargement des pages et à la compatibilité mobile du site.

Les raisons qui font que Google n'explore pas une page web

Les pages bloquées dans le fichier robots.txt ne seront pas explorées, mais peuvent tout de même être indexées si elles sont liées à une autre page, car Google peut toujours déduire son contenu, indexant ainsi cette dernière sans pour autant l’analyser.

Les pages inaccessibles à un utilisateur anonyme ne peuvent pas être explorées pour être incluses dans les résultats de recherche Google. Ainsi, toute protection par connexion ou autre demande d’autorisation empêchera l'exploration d'une page. 🚫🔐

Les doublons de contenu sont explorés moins fréquemment et peuvent même être bloquées afin de ne pas apparaître dans les résultats de recherche Google, ce qui peut nuire au PageRank global de votre site.

Le PageRank, c’est quoi ? 🤔

C’est l'un des principaux algorithmes utilisés pour classer les pages web. Il a été développé en 1996 par Larry Page et Sergey Brin à l'université de Stanford dans le cadre d'un projet de recherche, avant que les deux hommes ne lancent Google en 1997.

Ces techniques aideront Google à découvrir les pages que vous souhaitez voir indexées et classées en priorité…

Définition

Les plans XML servent de feuilles de route pour toutes les pages indexables de votre site web, ce qui rend leur exploration plus efficace pour les moteurs de recherche. Ils permettent également de différencier les pages et les fichiers que vous souhaitez que Google

indexe en priorité.

-

Soumettez des demandes d'exploration pour des pages individuelles à l'aide de Google Search Console.

-

Utilisez des chemins d'accès URL simples, clairs et logiques pour vos pages web.

-

Fournissez des liens internes clairs et directs au sein du site.

-

Utilisez des insertions qui permettent aux rédacteurs web d'être avertis lorsque d'autres webmasters créent un lien vers l'un de leurs articles de blog, ce qui contribue efficacement à la construction d'un maillage idéal pour les robots d'indexation.

-

Utilisez le fichier robots.txt pour indiquer à Google les pages que vous souhaitez qu'il indexe en priorité, ce qui peut réduire la charge de votre serveur.

-

Identifiez clairement les structures d'URL canoniques.

Définition

Une URL canonique est l’adresse principale d’une page web, choisie pour éviter les doublons et indiquer aux moteurs de recherche quelle version afficher dans les résultats.

-

Consultez la couverture de votre crawl et de votre index à l'aide du rapport Google correspondant.

-

Assurez-vous que Google peut accéder aux ressources importantes associées à votre page web, notamment les images, les fichiers CSS et les scripts qui peuvent être nécessaires au bon affichage de votre page. Pour cela, utilisez un outil d'inspection des URLs. 🛠️

Si vous avez un nouveau site web, Google peut mettre un certain temps à l'indexer, car il doit d'abord être exploré. Et l'exploration peut prendre de quelques jours à quelques semaines. ⌚

Mais vous pouvez accélérer le processus...

Google Search Console

Le moyen le plus simple consiste à demander l'indexation dans Google Search Console.

GSC est un ensemble d'outils gratuits qui vous permet de vérifier la présence de votre site web sur Google et de résoudre les problèmes éventuels.

Si vous n'avez pas encore de compte GSC, vous devez :

-

Vous connecter avec votre compte Google.

-

Ajouter une nouvelle propriété (votre site web) à votre compte.

-

Vérifier que vous êtes bien le propriétaire du site web.

Sur SiteW, vous connectez votre compte GSC à votre tableau de bord, en quelques clics seulement pour un accès ultra facilité à vos statistiques web.

Créer un site web bien référencé

Créez du contenu de haute qualité

Un contenu de qualité, «utile, fiable et axé sur l’expérience», a plus de chances d'être indexé et affiché dans les résultats de recherche.

Voici quelques conseils dans ce sens :

-

Centrez votre contenu sur les besoins et les difficultés des clients. Abordez les problèmes et les questions pertinents et proposez des solutions concrètes.

-

Mettez en avant votre expertise. Publiez du contenu rédigé par des experts ou incluez leurs points de vue. Partagez des exemples concrets et l'expérience de votre marque sur le sujet.

-

Mettez à jour vos contenus. Assurez-vous que ce que vous publiez est pertinent et actualisé. Effectuez régulièrement des audits afin d'identifier les erreurs, les informations obsolètes et les possibilités d'amélioration.

➡️ En créant un contenu informatif, bien documenté et original, vous signalez à Google que votre site web est une ressource précieuse qui mérite d'être indexée.

Créez des backlinks pertinents

Google considère les backlinks (liens sur d'autres sites qui renvoient vers le vôtre) provenant de noms de domaine pertinents et de haute qualité comme des recommandations. 🗳️

De surcroît, avoir plus de backlinks facilite aussi l'indexation. En effet, le crawler de Google trouve de nouvelles pages à indexer grâce aux liens.

Vous pouvez utiliser différentes tactiques pour obtenir davantage de liens entrants de haute qualité. Par exemple, vous pouvez contacter de manière ciblée des journalistes et des blogueurs, rédiger des articles pour d'autres sites ou encore analyser les liens retour de vos concurrents afin d'identifier les opportunités que vous pouvez reproduire.

Voici quelques exemples :

-

Contribuer à des avis d'experts : trouvez des sites web ou des podcasts sur lesquels des marques concurrentes interviennent ou publient. Contactez ces personnes pour collaborer.

-

Créer un meilleur contenu : voyez dans quelles publications en ligne vos concurrents apparaissent. Envisagez de créer une page similaire mais meilleure, avec des idées originales, puis proposez-la aux webmasters concernés en tant que lien de remplacement.

👉 Les liens retour, en particulier ceux provenant de sites réputés, sont un gage de fiabilité et indiquent à Google que votre contenu est précieux et mérite d'être classé et indexé.

Améliorer les signaux E-E-A-T

E-E-A-T signifie « expérience, expertise, autorité et fiabilité ». Ces critères de qualité sont utilisés par les internautes et par Google pour évaluer les résultats de recherche.

Cela signifie que créer des pages en tenant compte de l'E-E-A-T est plus susceptible d'améliorer vos performances web.

Pour améliorer ces paramètres, visez à :

-

Fournir des informations transparentes sur les auteurs. Mettez en avant l'expérience personnelle et l'expertise de vos contributeurs sur les sujets traités.

-

Collaborer avec des experts. Intégrez les avis de professionnels du secteur. Vous pouvez même les engager pour qu'ils vérifient votre contenu et s'assurent de son exactitude. 👨🎓

-

Étayer vos affirmations. Citez des sources fiables dans tous vos contenus publiés. Ainsi, les lecteurs sauront que les informations que vous fournissez sont dignes de confiance. 📖

Liens internes

Les liens internes constituent un autre facteur SEO qui influe sur l'indexation de votre site.

Il est courant de trouver des pages web qui ne sont liées à aucune autre page du même domaine. Ce sont des pages orphelines.

Bien qu'indexables, elles sont difficiles à localiser tant par les utilisateurs que par les moteurs de recherche. Leur autorité est réduite et Google peut décider de ne pas les indexer du tout.

Fichier robots.txt et balise noindex

Le fichier robots.txt et la balise noindex sont essentiels pour diriger les activités d'exploration et d'indexation de Google. Le fichier robots.txt peut demander à Google de ne pas explorer certaines pages de votre site, tandis que la balise noindex indique explicitement de ne pas inclure une certaine page dans son index.

Ces outils sont efficaces pour empêcher l'indexation de certaines sections ou pages de votre site web. Cependant, il est important de les utiliser à bon escient. Assurez-vous que les pages importantes ne sont pas restreintes ou marquées par erreur. 🤓☝️

Évitez le contenu dupliqué

De grandes quantités de contenu dupliqué peuvent gaspiller le budget d'exploration de Google et empêcher les moteurs de recherche d'indexer correctement votre site web.

Idéalement, toutes les pages doivent être uniques et avoir un contenu distinct les unes des autres. Cependant, lorsque vous avez un contenu très similaire, voire identique, apparaissant sur plusieurs pages de votre site web, cela perturbe Google et rend difficile pour le moteur de recherche de déterminer quelle version indexer. Cette concurrence réduit malheureusement les performances de toutes les pages. 👎

Pourquoi bloquer certaines pages pour qu'elles n'apparaissent pas dans les SERPs ?

Dans certains cas, vous pouvez vouloir bloquer certaines pages afin de maintenir un index de haute qualité ou de protéger des informations sensibles.

Raisons classiques poussant à bloquer certaines pages :

- Contenu dupliqué : bloquer les pages dupliquées permet de s'assurer que les moteurs de recherche se concentrent sur le contenu original et canonique, évitant ainsi les problèmes de classement.

- Informations privées ou confidentielles : les pages contenant des informations sensibles (telles que les pages de compte utilisateur ou les documents internes) doivent être bloquées afin de protéger la confidentialité.

- Contenu de mauvaise qualité ou insuffisant : les pages dont le contenu est peu ou pas utile peuvent nuire à la qualité globale de votre site. Il est donc préférable de les exclure de l'index.

- Sites de test ou de pré-production : les pages en cours de développement ou faisant partie d'un environnement de test doivent être bloquées pour les moteurs de recherche afin d'éviter qu'elles ne soient indexées prématurément. 🧪

- robots.txt : ce fichier indique aux robots des moteurs de recherche quelles pages ou sections de votre site ne doivent pas être explorées. Soyez prudent, car le blocage de pages essentielles pourrait nuire à votre référencement.

Vous pouvez consulter votre fichier robots.txt à l'adresse : https://[votredomaine]/robots.txt.

- Balises méta : la balise méta «robots noindex» peut être utilisée sur des pages individuelles pour empêcher leur indexation, sans bloquer entièrement les crawlers. Si vous en avez besoin, vous la trouverez généralement dans les paramètres ou la section SEO lorsque vous modifiez votre site web.

- Protection par mot de passe : pour les pages hautement sensibles, vous pouvez utiliser la protection par mot de passe afin de les garder privées et inaccessibles aux robots des moteurs de recherche.

L’indexation Google n’est pas une simple étape technique : c’est le socle de votre visibilité en ligne.

Sans elle, aucun trafic, aucune conversion. 🙅

En appliquant les bonnes pratiques et en corrigeant les erreurs bloquantes, vous donnez à votre site toutes les chances d’exister, de performer et de croître durablement. 📈